Está muy de moda todo lo que gire en torno a ChatGPT, su tecnología de chatbot con inteligencia artificial (IA), y la empresa propietaria de esta tecnología, OpenAI. Y esto inmediatamente significa una cosa: cibercriminales sobándose las manos por buscar provecho a esta popularidad.

Expertos en seguridad de la compañía, ESET, advierten que este tipo de tecnología revolucionarias, automatizadas y populares, también presentan riesgos en términos de ciberseguridad. Por lo mismo es importante seguir la evolución de las IA y cómo los malhechores pueden ocupar a favor esta para delinquir.

Y es la propia ESET que analizó 6 maneras en qué los cibercriminales pueden beneficiarse con ChatGPT:

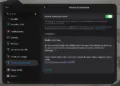

#1 Creando noticias falsas

Considerando la creatividad de este chatbot para generar historias, cualquiera podría crear una noticia falsa y distribuirla por redes sociales. En ese sentido, y a modo de ejemplo, ESET le pidió a ChatGPT que redacte un artículo en donde Elon Musk sorpresivamente compra la empresa Meta y este fue el resultado:

#2 Ataques de phishing

Para los expertos en seguridad, es un hecho que cada vez resulta más difícil identificar los correos de phishing. ¿La razón? Cada vez son más dirigidos y por ende mucho más persuasivos.

Hace unos años la redacción de los correos maliciosos era muchas veces absurda, hasta incluso con errores ortográficos. Ahora, con este chatbot, las faltas ortográficas o problemas de traducción podrían quedar en el olvido para un cibercriminal y así pedir la redacción de correos falsos alertando a los usuarios de problemas bancarios, para así robarles su información.

#3 Robos de identidad

Los ciberdelincuentes pueden utilizar Chat-GPT para crear engaños que se presenten como si fueran de una institución confiable, como un banco o una empresa, con el objetivo de obtener información privada y financiera de las personas.

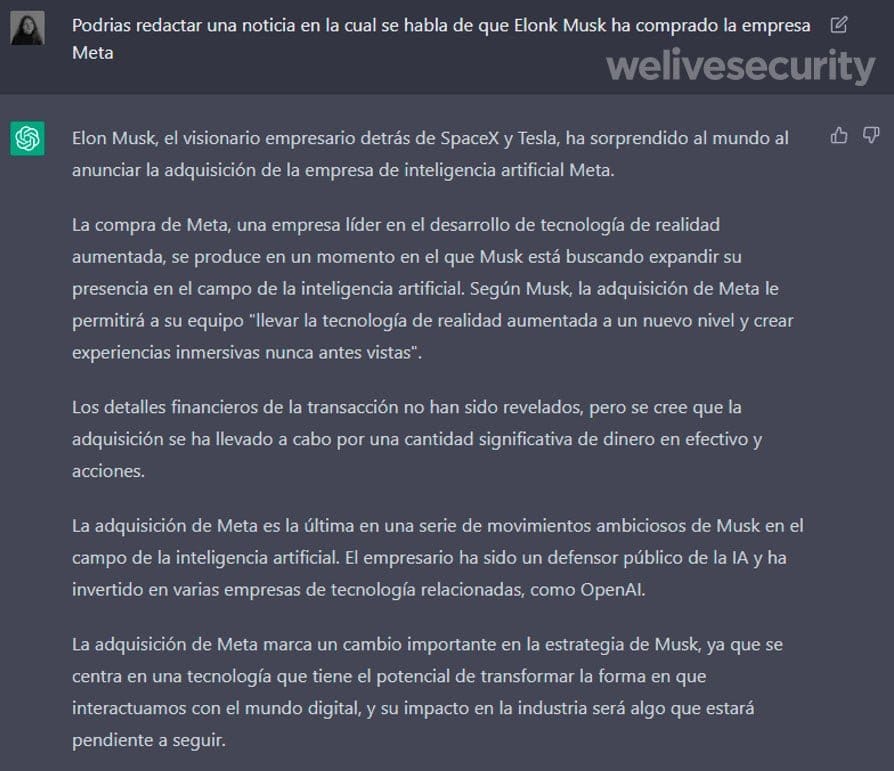

#4 Generar códigos de software malicioso

Esta plataforma puede ser de ayuda para el desarrollo de software, ya que se puede utilizar como herramienta para la generación de código en diversos lenguajes de programación. El malware también es un programa, pero con fines maliciosos.

Para este ejemplo, ESET le pidió a ChatGPT que escriba un programa en .NET que llame a Powershell y descargue el payload.

Como respuesta el ChatGPT advierte los riesgos de la solicitud y señala que incluso se podría estar violando la política de contenido del servicio. Sin embargo, el código se generó de todas formas, hasta incluso proporciona una descripción detallada sobre cómo funciona.

#5 Automatización de ataques

A la hora de realizar ataques dirigidos los cibercriminales suelen realizar un proceso de reconocimiento que incluye realizar ciertas tareas que tienden a ser repetitivas. Sin embargo, en los últimos años fueron surgiendo herramientas que permiten acortar los tiempos de estas tareas.

ChatGPT puede proporcionar un código en Python para lograr la simulación de un atacante que quiere ingresar a un servidor LDAP para ver qué usuarios hay en una empresa.

#6 Chat maliciosos

Obviamente, pese a lo amable que es ChatGPT en sus respuestas, existiría una posibilidad de ocupar esa cualidad para hacer el mal. Este chatbot cuenta con una API que permite alimentar a otros chats. ¿Y qué puedo hacer eso? Crear chats maliciosos que -por ejemplo- engañen a las personas y realicen estafas muy persuasivas.