TikTok implementará una nueva función que permitirá a los usuarios decidir cuánto contenido generado por inteligencia artificial desean ver en su sección Para ti. La medida, que se pondrá a prueba en las próximas semanas antes de su lanzamiento global, busca dar a los usuarios un mayor control sobre su experiencia y reforzar la transparencia en torno al uso de herramientas de IA en la plataforma.

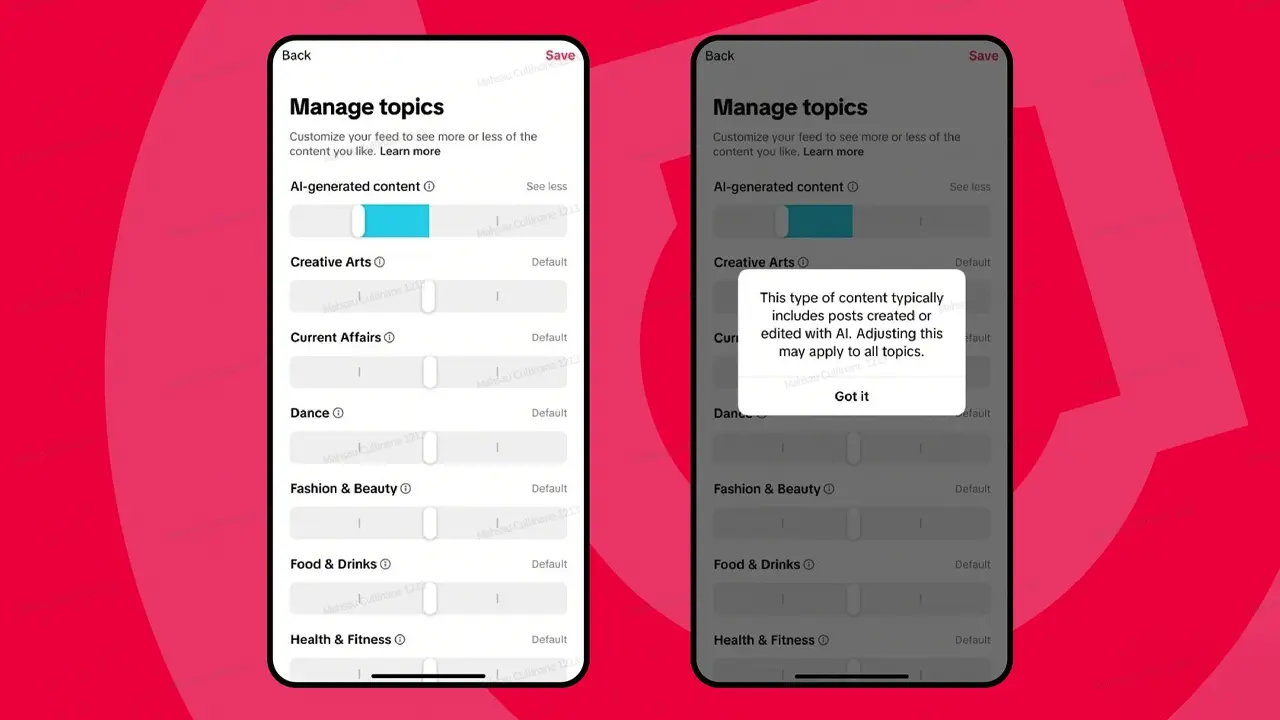

El nuevo control se integrará dentro del apartado «Administrar temas», donde ya es posible ajustar la frecuencia de categorías como deportes, moda o gastronomía. Desde allí, cada usuario podrá mover un control deslizante para aumentar o reducir la presencia de videos etiquetados como creados con inteligencia artificial. TikTok aclaró que esta opción no eliminará el contenido de IA, sino que permitirá equilibrar la diversidad de publicaciones en función de las preferencias personales.

Más transparencia y nuevas etiquetas en TikTok

La compañía explicó que su decisión llega tras un incremento notable de videos creados con modelos generativos como Sora de OpenAI o Veo 3 de Google. Actualmente, hay más de 1,3 mil millones de videos etiquetados como generados por IA en la plataforma, una fracción pequeña dentro de los más de 100 millones de publicaciones que se suben cada día.

Para mejorar la detección y el etiquetado de este tipo de materiales, TikTok está incorporando un sistema de «marcas de agua invisibles». Estas señales, que solo la plataforma puede leer, complementan la tecnología de Content Credentials del consorcio C2PA, utilizada para incrustar metadatos que indican si un contenido fue creado mediante inteligencia artificial. El objetivo es evitar que los marcadores se pierdan al editar o volver a subir videos en otras redes.

Además, la empresa ha anunciado un fondo de alfabetización en IA de 2 millones de dólares destinado a expertos y organizaciones educativas, entre ellas Girls Who Code, para producir contenidos sobre el uso responsable de la inteligencia artificial y la seguridad digital. Según TikTok, estas iniciativas forman parte de su estrategia global para reforzar la comprensión pública de la tecnología y reducir la propagación de materiales engañosos o de baja calidad.

El cambio fue presentado durante el foro europeo de confianza y seguridad de la compañía, realizado en Dublín, donde también se subrayó la importancia de equilibrar la intervención humana con los sistemas automatizados en la moderación de contenidos. La empresa indicó que el uso de herramientas de IA ha permitido reducir en un 76% la exposición de sus moderadores a materiales gráficos o perturbadores.