iOS 18.2 incorporará una nueva función de seguridad infantil que permite a los propios menores de edad, reportar imágenes y videos explícitos en iMessage y otras Apps de Apple. Esta actualización, inicialmente habilitada en Australia, aplica un análisis automatizado en el dispositivo para identificar y desenfocar contenido potencialmente sensible antes de que el destinatario lo vea.

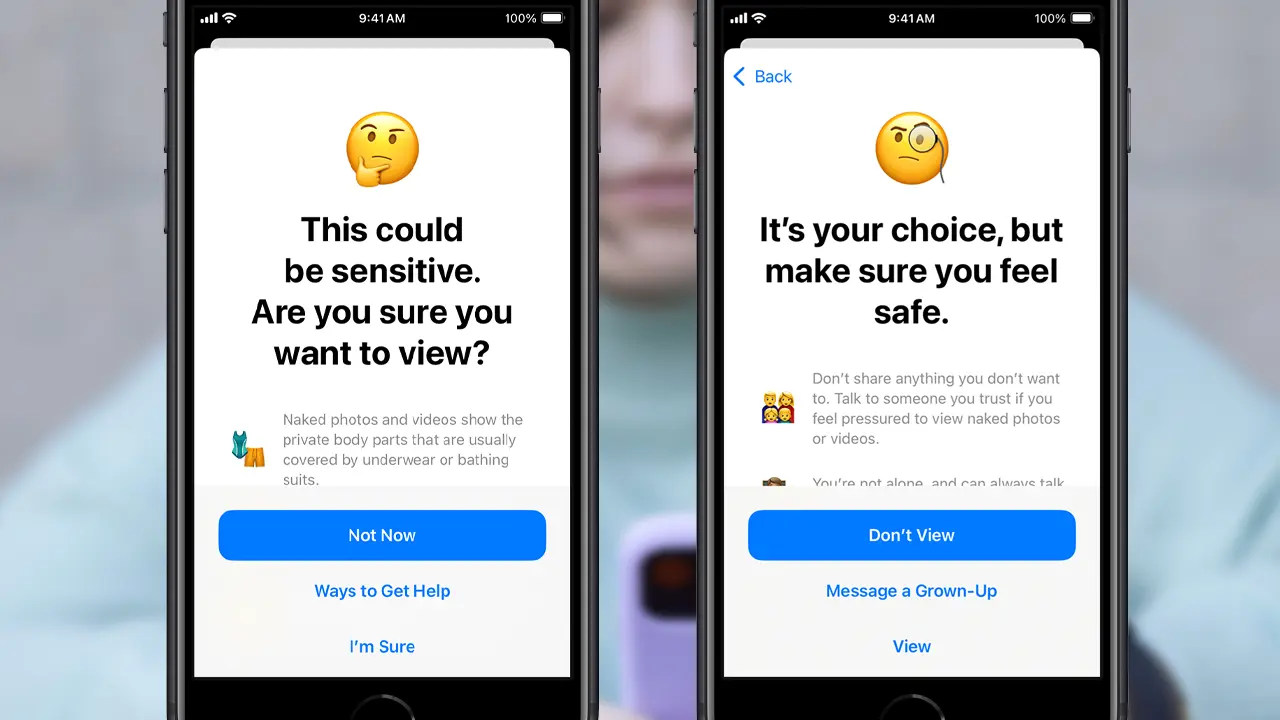

La función, llamada «Communication Safety», se activa de manera predeterminada en equipos Apple que están configurados para niños menores de 13 años. Al detectar una imagen o video con contenido explícito, el sistema muestra una advertencia y bloquea la visualización del material hasta que el menor ingrese el código de tiempo de pantalla, una medida adicional para evitar el acceso involuntario a este tipo de contenidos.

Funcionalidades avanzadas de iOS 18.2

Esta versión del sistema operativo móvil de Apple expande las opciones de seguridad con la posibilidad de reportar el contenido explícito detectado directamente a la compañía. Si el menor decide informar sobre el contenido, el sistema crea un informe que incluye el archivo multimedia en cuestión, los mensajes anteriores y posteriores al envío, y la información de contacto del remitente. Este informe se envía a Apple para revisión y podría derivar en acciones específicas, como la suspensión de la capacidad del usuario denunciado para enviar mensajes a través de iMessage. Además, en ciertos casos, Apple podría remitir el informe a las autoridades competentes.

Communication Safety se diseñó para proteger la privacidad de los usuarios menores sin comprometer el cifrado de extremo a extremo en iMessage. Todo el proceso de detección ocurre dentro del propio dispositivo y no implica el envío de información a servidores externos, de acuerdo con los principios de privacidad de Apple. Esta herramienta funciona con iMessage y también con Apps como FaceTime, AirDrop y Contact Posters en iPhone, iPad y otros dispositivos del ecosistema de la manzana.

Y, ¿por qué esta función de iOS 18.2 sólo se limita a Australia? Debido a que con esta activación controlada se espera que se cumplan con los nuevos reglamentos que exigen a las empresas tecnológicas mecanismos para controlar contenidos de abuso infantil y terrorismo en línea. Apple ha indicado que la herramienta se extenderá a nivel global en el futuro, aunque aún no se ha anunciado una fecha específica para su disponibilidad mundial.