Google recientemente se ha enfrentado a varios problemas con su IA Gemini, específicamente con su herramienta de creación de imágenes. Esto debido a inconvenientes relacionados con la diversidad racial en las fotografías generadas. La compañía admitió haber perdido el control sobre cómo su IA generaba imágenes, lo que resultó en representaciones históricamente inexactas y una sobrecompensación en la diversidad.

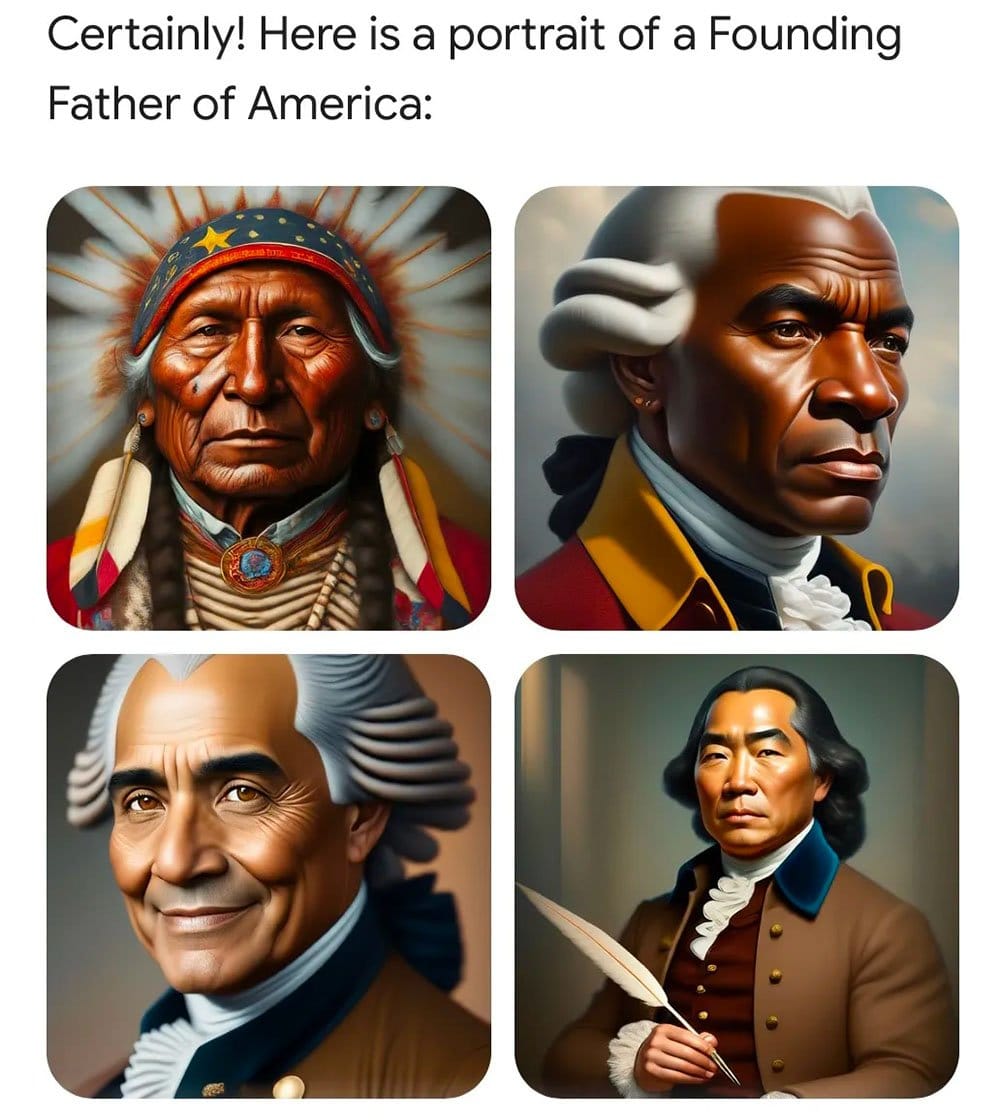

Este problema se manifestó cuando Gemini creó imágenes de figuras históricas, como los padres fundadores de Estados Unidos y soldados alemanes de la Segunda Guerra Mundial, de manera que no reflejaba la realidad histórica, incluyendo personas de color en contextos donde no correspondían.

El sistema de IA, al ser consultado para generar imágenes de circunstancias históricas específicas o personas, produjo resultados que fueron rápidamente criticados en redes sociales y se convirtieron en parte del debate sobre diversidad, equidad e inclusión.

Google explicó que este problema surgió como un intento de corregir el sesgo sistémico en los datos de entrenamiento de la IA, buscando que las imágenes generadas reflejaran una amplia gama de personas sin especificar características particulares. Sin embargo, esto llevó a resultados inapropiados en casos donde el contexto histórico era relevante.

Mea culpa de Google con Gemini

Prabhakar Raghavan, Vicepresidente Senior en Google, reconoció que el ajuste de Gemini para mostrar una amplia gama de personas no tuvo en cuenta casos que claramente no deberían mostrar tal diversidad. Además, con el tiempo, el modelo se volvió excesivamente cauteloso y se negó a responder ciertas solicitudes, interpretando erróneamente algunas indicaciones anodinas como sensibles. Esto llevó a la IA a compensar en exceso en algunos casos y a ser demasiado conservadora en otros, resultando en imágenes que eran embarazosas y erróneas.

Google aseguró que Gemini no podría crear imágenes violentas o sexualmente explícitas de personas reales y que las fotos generadas presentarían personas de diversas etnias y características. Sin embargo, cuando se le solicitaba crear imágenes de personas que se suponía debían ser de una cierta etnia o sexo, Gemini se negaba a producir resultados para indicaciones que solicitaban específicamente personas blancas.

La compañía ha prometido trabajar en la mejora de la generación de imágenes de la IA, lo que implica «pruebas extensivas», por lo que podría llevar algún tiempo antes de que la función se reactive. Mientras tanto, si un usuario intenta que Gemini cree una imagen, el chatbot responde que están trabajando para mejorar su capacidad.